NVIDIA V100 se Torna Opção Atrativa para IA com Queda de Preço

A NVIDIA V100, GPU de Data Center lançada em 2017 por mais de US$ 10 mil, se transformou em um dos achados mais cobiçados do mercado de Inteligência Artificial (IA) após despencar para apenas US$ 100 (cerca de R$ 495) no eBay. Essa mudança imperceptível nas prateleiras digitais chamou a atenção não apenas dos entusiastas de hardware, mas também da imprensa especializada, que vem analisando a relevância desta placa de vídeo no atual cenário tecnológico.

O que Aconteceu?

A repentina valorização da V100 surge de um experimento realizado pelo criador do canal Hardware Haven, que adaptou a placa para um PC convencional e demonstrou em vídeo que a relíquia de 8 anos é capaz de superar concorrentes muito mais novas, como a GeForce RTX 3060 e a Radeon RX 7800 XT, na geração de tokens em modelos de Linguagem de Máquina (LLMs).

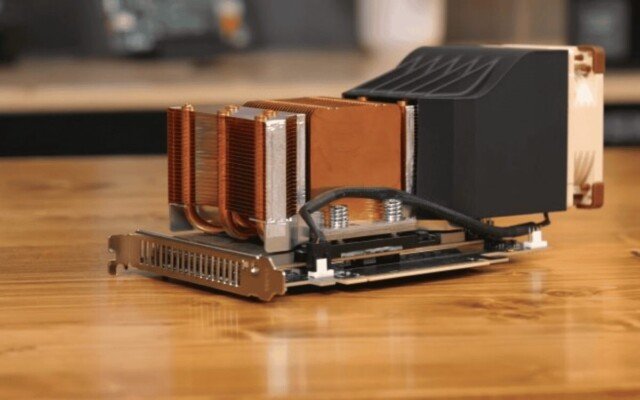

O setup, que inclui um adaptador SXM2 para PCIe, uma ventoinha Noctua e um duto impresso em 3D, custou em média apenas US$ 235 (cerca de R$ 1.163 na cotação atual). A relação custo-benefício despertou interesse imediato, fazendo com que a V100 retornasse à pauta de discussões entre profissionais e amadores do setor.

Detalhes do Experimento

O experimento realizado por Hardware Haven enfrentou o primeiro desafio imposto pelo formato da V100. A versão SXM2, em vez de ser uma placa PCIe convencional, utiliza um conector mezzanine, que é um padrão de servidor. Para contornar esta limitação, o criador utilizou um adaptador SXM2 para PCIe, acessível por cerca de US$ 100 em marketplaces. Este adaptador possibilitou inserir a V100 em uma motherboard ATX comum, otimizando seu uso.

Além disso, o aquecimento da V100 era uma preocupação, uma vez que ela conta com um heatsink passivo. Para solucionar isso, Hardware Haven imprimiu um duto em 3D e instalou uma ventoinha Noctua de 80 mm, garantindo que o fluxo de ar fosse direcionado para o dissipador de forma eficaz.

Desempenho Surpreendente em LLMs

Os benchmarks realizados em modelos locais mostraram resultados surpreendentes. No primeiro teste, utilizando o GPT-OSS com 20 bilhões de parâmetros, a V100 apresentou uma taxa de geração de cerca de 130 tokens por segundo, superando os 90 tokens por segundo da Radeon RX 7800 XT.

Em um segundo teste com o modelo Gemma 4 E4B, a V100 registrou 108 tokens por segundo, enquanto a RTX 3060 ficou com 76 tokens por segundo. A diferença de 42% a favor da V100 é impressionante, levando em conta que o consumo energético desta última foi maior (293W contra 235W na RTX 3060), mas em termos de eficiência, ainda assim conseguiu manter uma vantagem de 12% em tokens gerados por watt.

“Não é a placa mais nova, datada de 2017, mas isso não significa que ela não rode os modelos abertos atuais.” – Hackaday

Hackaday

Eficiência Energética e Desempenho a Longo Prazo

A eficiência energética da V100 também surpreendeu quando aplicada um limite de potência de 100W. No teste, a GPU conseguiu se manter em 95 tokens por segundo com um consumo total de 170W, superando mais uma vez a RTX 3060, que despencou para 68 tokens por segundo. Essa informação desafia a noção prevalente de que o hardware mais novo necessariamente apresenta melhor eficiência.

A largura de banda extraordinária da V100, de aproximadamente 898 GB/s, é um fator crucial que a posiciona à frente na inferência local de LLMs, sendo muito superior à GDDR6 da RTX 3060, que possui cerca de 360 GB/s.

Especificações Técnicas e Longo Prazo

Por detrás do desempenho atual da V100, existem especificações que continuam impressionantes após quase uma década. A V100 SXM2 é baseada na arquitetura Volta, possui 5.120 CUDA Cores, 640 Tensor Cores e 16 GB de HBM2. O preço original de lançamento excedeu US$ 10 mil, e agora é facilmente encontrada por US$ 100 no mercado secundário.

Desafios para Entusiastas

No entanto, a compra da V100 não é isenta de desafios. A falta de saídas de vídeo, o consumo elevado em modo idle e a questão dos drivers, que estão em modo legacy support, podem desencorajar alguns usuários. Essas limitações podem impactar seriamente a experiência de uso para indivíduos que buscam uma solução multifuncional para jogos e trabalho.

Conclusões e Reflexões

Para quem busca uma GPU dedicada a inferência local de LLMs, a NVIDIA V100, mesmo com suas limitações, apresenta-se como uma alternativa excelente em relação ao valor investido. Um setup composto pela V100, adaptador e ventoinha totaliza cerca de R$ 1.160, vencendo a concorrência de uma RTX 3060 em termos de eficiência. O mercado de GPUs continua a evoluir rapidamente e a nova apreciação por um modelo antigo exemplifica as transformações na demanda por performance em IA.

À medida que o preço se mantém na casa dos US$ 100, a questão que persiste é: por quanto tempo a V100 conseguirá ser uma opção viável até que a arbitragem de preços a torne menos acessível?